Eficiencia en LLMs: por qué la atención cuadrática es el techo, y qué viene después

La atención de los Transformers crece al cuadrado: doblar el contexto cuadruplica el coste. La industria ataca este techo desde cinco frentes; los precios de inferencia van a bajar 5-50x en 18-24 meses.

Cómo leer esta nota. Está dividida en dos partes. La Parte 1 está pensada para cualquiera con interés en hacia dónde va la IA, sin requisitos técnicos. La Parte 2 entra en la arquitectura, las matemáticas básicas y los papers. Puedes leer una, la otra, o las dos. El TL;DR de abajo aplica a ambas.

TL;DR

- Los LLMs actuales (GPT, Claude, Gemini) usan una operación llamada atención cuyo coste crece al cuadrado con la longitud del texto que procesan. Doblar el contexto cuadruplica el coste. Esto es por qué un prompt de 1 millón de tokens es ~100x más caro que uno de 100.000.

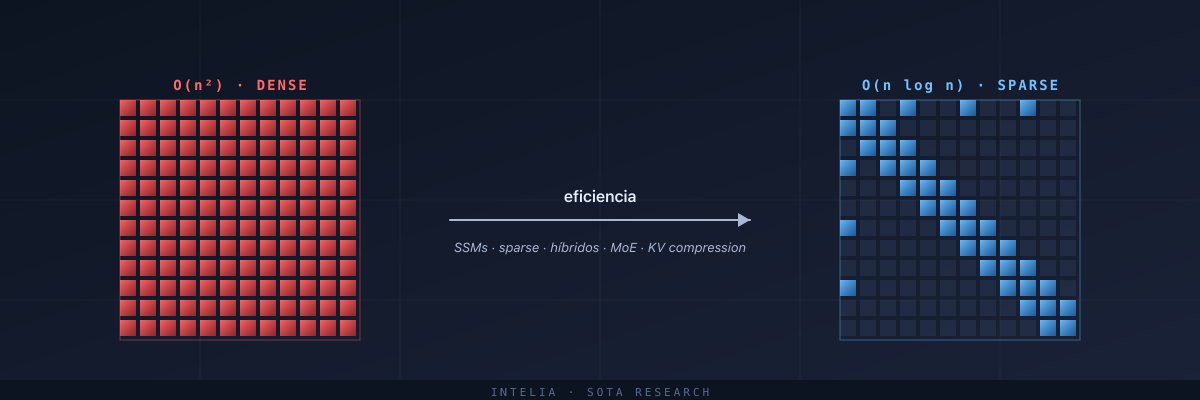

- La industria está atacando este techo desde cinco frentes paralelos: arquitecturas alternativas (Mamba/SSMs), atención dispersa (sparse attention), modelos híbridos, mezcla de expertos (MoE) y compresión del cache de inferencia.

- Mi lectura: la combinación realista a 12-18 meses es híbrido + MoE + KV cache compression. La apuesta más arriesgada es sustituir la atención del todo (Mamba puro). El lanzamiento de SubQ esta semana es un intento de la línea sparse, pero con muchas dudas abiertas sobre si los números aguantan auditoría.

- Para una empresa que use LLMs en producción, la implicación práctica es que los precios de inferencia van a bajar entre 5x y 50x en 18-24 meses. Casos de uso que hoy son inviables económicamente (agentes que mastiquen un repo entero, asistentes con memoria de toda la historia de un cliente) pasarán a ser triviales. Quien hoy esté esperando a que "bajen los costes" para automatizar, va a llegar tarde.

Parte 1 — Para entender de qué va, sin tecnicismos

El problema del impuesto invisible

Imagina que cada vez que un asistente de IA lee un documento que le pasas, tiene que comparar cada palabra con todas las demás palabras del documento, una a una. Si el documento tiene 1.000 palabras, son un millón de comparaciones. Si tiene 10.000 palabras, son cien millones. Si tiene un millón de palabras, son un billón de comparaciones.

Eso es lo que hacen, simplificando, los modelos tipo GPT y Claude por debajo. Esa operación se llama atención, y es la responsable de que el modelo entienda qué partes del texto se relacionan con cuáles. Es lo que hace que un LLM sepa que "él" en la última frase se refiere a "Pedro" mencionado tres párrafos antes.

El problema es que ese mecanismo escala fatal con la longitud. Doblar el texto no dobla el coste — lo cuadruplica. Esto es por qué los modelos con contexto enorme (1M tokens, equivalente a un libro mediano) salen tan caros. No es que las empresas sean avaras: es que computacionalmente cuesta una pasta.

Por qué importa esto para tu negocio

Hoy, casi cualquier empresa que quiera usar IA "en serio" se choca con este muro:

- Asistentes que conozcan toda la historia de un cliente: técnicamente posible, prácticamente carísimo si la historia es de años.

- Agentes que entiendan un código base entero: hoy se hacen trucos (RAG, búsquedas, resúmenes) porque meter el repo completo en cada llamada cuesta demasiado.

- Análisis de documentos legales o financieros largos: factible para casos puntuales, prohibitivo para volumen alto.

Es decir, el techo de coste define qué casos de uso son viables. Y ese techo se está moviendo.

Las cinco apuestas de la industria

Hay cinco formas distintas de atacar esto. No compiten entre sí — se combinan.

- Cambiar la arquitectura por una más eficiente (Mamba, SSMs). Sustituir la atención por un mecanismo que escale linealmente, no cuadráticamente. Es la apuesta más radical: si funciona, todo es 10-100x más barato. Si no funciona del todo, los modelos pierden algo de calidad en tareas que requieren conexiones largas.

- Hacer la atención más "selectiva" (sparse attention). En lugar de comparar cada palabra con todas las demás, que el modelo aprenda a ignorar la mayoría de comparaciones — solo mira lo que parece relevante. SubQ, la noticia de esta semana, va por ahí.

- Mezclar lo viejo y lo nuevo (híbridos tipo Jamba). Capas de Mamba intercaladas con capas de Transformer tradicional. Te llevas eficiencia de uno y calidad del otro. Está en producción ya.

- Activar solo parte del modelo (Mixture of Experts, MoE). El modelo tiene 100B parámetros pero solo usa 10B en cada respuesta — los "expertos" relevantes para el tema. Calidad de modelo enorme al coste de uno mediano. Qwen 3.5 y otros ya lo hacen.

- Comprimir la memoria (KV cache compression). Cuando un modelo procesa un texto largo, va guardando "memoria" intermedia. Esa memoria ocupa muchísimo. Comprimirla 6x sin perder precisión es lo que ha conseguido Google con TurboQuant en marzo 2026. No cambia la arquitectura, solo hace cada inferencia mucho más barata.

Hacia dónde va esto

Mi lectura es que en 18-24 meses los precios de inferencia van a bajar entre 5x y 50x combinando varias de estas técnicas. Eso no significa que los LLMs frontera sean gratis — significa que lo que hoy parece caro será trivial, y lo que hoy es imposible será caro pero asumible.

Para una empresa, la implicación es estratégica: los casos de uso que hoy descartas por coste deberías estar diseñándolos ahora. Cuando los precios bajen, quien tenga el producto pensado y los datos preparados gana 12 meses de ventaja sobre quien empiece desde cero.

Esto es lo de fondo. Si quieres entender cómo funciona cada una de estas líneas y por qué algunas son más prometedoras que otras, sigue a la Parte 2.

A partir de aquí, la Parte 2 entra en arquitectura, matemáticas y papers. Si solo te interesaba el "qué" y no el "cómo", puedes parar aquí.

Parte 2 — Cómo funciona por dentro (técnica)

2.1 — Cómo funciona la atención en un Transformer

El Transformer (Vaswani et al., 2017) es la arquitectura detrás de prácticamente todos los LLMs actuales. Su núcleo es el mecanismo de self-attention.

Dado un input de n tokens, el modelo proyecta cada token en tres vectores: Query (Q), Key (K) y Value (V). Para calcular la representación contextualizada de cada token, hace:

Attention(Q, K, V) = softmax(Q · Kᵀ / √d) · VLo importante de esa fórmula es el producto Q · Kᵀ: una matriz de n × n. Para cada uno de los n tokens, se computa un score con cada uno de los otros n tokens. Eso da n² operaciones y, para guardar los resultados intermedios durante inferencia, n² memoria (el famoso KV cache, aunque en la práctica el cache es n × d).

A nivel de complejidad:

- Compute: O(n² · d) donde d es la dimensión del modelo.

- Memoria del KV cache: O(n · d · L) donde L es número de capas (y en la práctica esto domina la memoria a contextos largos).

Por eso a 1M tokens con un modelo grande hablamos de centenares de GB solo de cache, y por qué Anthropic cobra ~$15/M tokens en input para Opus en contextos largos: el coste real de hardware es brutal.

2.2 — Las cinco líneas de research que atacan O(n²)

A) State Space Models (SSMs) — Mamba y derivados

Los State Space Models sustituyen la atención por una recurrencia tipo RNN, pero diseñada para entrenarse en paralelo (como un Transformer) y ejecutarse con coste lineal en n.

- Mamba (Gu & Dao, 2023): introduce selectivity — los parámetros del SSM dependen del input, lo que le da capacidad de "elegir" qué recordar. Es la primera arquitectura subcuadrática que iguala a Transformer en language modeling a escalas medianas.

- Mamba-3 (2026): mejora la recurrencia derivándola de la discretización del SSM y añade actualización con valores complejos para mejor state tracking. Optimizado de cara a inferencia.

- Trade-off conocido: los SSMs flaquean en tareas de recall exacto a larga distancia (encontrar una aguja literal en un pajar muy largo). La atención de Transformer sigue siendo mejor ahí. De ahí los híbridos.

Estado: Mamba puro es prometedor pero todavía no compite a frontier scale en producción.

B) Sparse Attention — el camino de SubQ

La intuición: en una matriz de atención n × n, la mayoría de scores son irrelevantes. Si el modelo aprendiera qué subset es importante para cada token, podría calcular atención solo sobre ese subset y reducir compute drásticamente.

Hay dos sabores:

- Sparsity estructurada (BigBird, Longformer): patrones fijos — atención local + algunos tokens "globales". Funciona, pero es rígida.

- Sparsity content-dependent: el modelo decide dinámicamente a qué tokens atender en función del contenido. Es lo que SubQ llama SSA (Subquadratic Sparse Attention). DeepSeek también ha publicado sobre Sparse Attention en esta línea.

El problema con SubQ específicamente:

- Su CTO admitió tras críticas de Will Depue (ex-OpenAI) que están usando pesos open-source como starting point (probablemente Kimi o DeepSeek). No es un modelo entrenado from scratch — es un finetune de uno existente con sparse attention encima.

- Solo han publicado 3 benchmarks (RULER 128K, needle@12M, MRCR v2), todos enfocados a long-context. Ningún test de razonamiento general, matemáticas, multilingüe o safety.

- Una sola run por benchmark "por coste". Eso permite cherry-picking estadístico.

- Sin paper técnico, sin pesos abiertos. Solo blog posts.

Aún así, su 95% en RULER 128K (vs 94.8% de Opus 4.6) está verificado por tercero, y la técnica de selección content-dependent es legítima. La duda es si los números de speedup (52x vs FlashAttention a 1M) aguantan replicación independiente.

C) Modelos híbridos — Jamba como referencia

La idea: si Mamba es bueno en throughput y Transformer en recall, alterna capas de ambos.

- Jamba (AI21, 2024) y Jamba 1.5: 72 capas que intercalan Mamba + grouped-query attention + MoE. Soporta 256K contexto en producción con throughput 2-3x superior a Transformer puro de tamaño equivalente.

- Resultado de evals: competitivo con Mixtral/Llama en benchmarks generales, claramente superior en throughput a long context.

Esta es probablemente la línea más madura técnicamente. Producción real, weights abiertos (Apache 2.0), papers detallados.

D) Mixture of Experts (MoE)

No ataca el O(n²) de la atención, pero ataca el coste total: en lugar de pasar cada token por todas las capas FFN, lo enrutan a un subset de "expertos".

- Modelo total: 100B parámetros. Activados por forward pass: 10B. Inferencia al coste de un modelo de 10B con la calidad de uno cercano a 100B.

- Ejemplos en producción 2026: Qwen 3.5 35B-A3B (35B totales, 3B activos), 122B-A10B, DeepSeek V3, Mixtral. Probablemente GPT-5.5 y Claude Opus 4.7 son MoE aunque OpenAI/Anthropic no publican detalles.

MoE es la palanca de coste más probada y desplegada hoy. Casi todos los modelos frontera ya la usan.

E) KV Cache compression / quantization

A contextos largos, lo que más memoria consume no es la matriz de atención (que se materializa por bloques) sino el KV cache acumulado de tokens previos durante autoregressive decoding.

Avances 2026:

- TurboQuant (Google, marzo 2026): compresión a 3 bits por valor del KV cache sin pérdida medible. 6x menos memoria.

- PolarQuant (AISTATS 2026): rotación ortogonal aleatoria a cada vector K/V antes de cuantizar — redistribuye varianza para mejor compresión.

- KIVI: 2.6x reducción de pico de memoria a 2 bits.

- Eviction policies (descarta tokens "menos importantes" del cache): H2O, StreamingLLM. Trade-off de recall a cambio de memoria.

KV compression es ortogonal a todo lo demás — se puede aplicar encima de Transformer, Mamba o híbrido. Es ganancia "gratis" (en el sentido de que no requiere reentrenar la arquitectura).

F) Bonus — Sparsity estructurada en hardware

Las GPUs Hopper/Blackwell aceleran nativamente 2:4 sparsity (de cada 4 valores, 2 son cero). Si entrenas el modelo respetando esa restricción, ganas ~1.5-2x en compute con cero cambio arquitectónico. Trick más que research, pero está en producción.

2.3 — Mi lectura del estado del arte

Ordenadas por probabilidad de impacto en los próximos 12-18 meses:

| Línea | Madurez | Probabilidad de impacto | Riesgo |

|---|---|---|---|

| MoE | Alta — ya en producción frontera | Muy alta | Bajo |

| KV cache compression | Alta — 2026 ha sido un año fuerte | Muy alta | Bajo |

| Híbridos (Jamba-style) | Media-alta — producción real | Alta | Medio |

| Sparse attention content-dependent | Media — research promete, prod incipiente | Media | Medio-alto (cherry-picking) |

| SSMs puros (Mamba-3) | Media — research sólido, producción rara | Media-baja | Alto (pérdida de calidad en recall) |

La apuesta más probable para "el siguiente Claude/GPT": arquitectura híbrida (atención dispersa + capas tipo Mamba) + MoE en las FFN + KV compression en serving. No una bala mágica — un combo.

SubQ, en contexto, es un experimento de la línea sparse content-dependent. Si sus números aguantan, es relevante. Si no, será una nota a pie de página tipo Magic.dev (que en 2024 prometió 100M context y a día de hoy no hay producto público).

2.4 — Implicaciones prácticas

Para una empresa que use LLMs en producción:

- Diseñar para contexto largo, no optimizar prematuramente. En 12-18 meses lo que hoy cuesta $10/query costará probablemente $1-2. Vale más tener el producto bien pensado que el RAG perfectamente afinado.

- MoE es ya el default en frontier. Si comparas precios, los modelos eficientes (DeepSeek V3, Qwen 3.5) ofrecen 5-10x mejor coste/calidad que dense models hace 18 meses.

- KV cache compression es la win más fácil. Si self-hosteas, herramientas como vLLM ya integran muchas de estas técnicas. Vale la pena medirlas.

- Vigilar sparse attention con escepticismo. Hasta que haya paper, weights abiertos y replicación independiente, los claims de 1000x son marketing. La técnica subyacente es real; la entrega comercial puede no estarlo.

Referencias

Papers fundacionales

- Vaswani et al. — Attention is All You Need (2017): https://arxiv.org/abs/1706.03762

- Gu & Dao — Mamba: Linear-Time Sequence Modeling with Selective State Spaces (2023): https://arxiv.org/abs/2312.00752

- Lieber et al. — Jamba: A Hybrid Transformer-Mamba Language Model (2024): https://arxiv.org/abs/2403.19887

- Kamradt — RULER: What's the Real Context Size of Your Long-Context Models? (2024): https://arxiv.org/abs/2404.06654

State of the art 2026

- Mamba-3: Improved Sequence Modeling using State Space Principles (OpenReview 2026): https://openreview.net/forum?id=HwCvaJOiCj

- Advancing Intelligent Sequence Modeling: Evolution from S4 to Mamba (arXiv 2026): https://arxiv.org/abs/2503.18970

- Top 10 KV Cache Compression Techniques (MarkTechPost, abr 2026): https://www.marktechpost.com/2026/04/29/top-10-kv-cache-compression-techniques-for-llm-inference-reducing-memory-overhead-across-eviction-quantization-and-low-rank-methods/

- The Rise of Inference Optimization (Dev Journal, abr 2026): https://earezki.com/ai-news/2026-04-19-the-rise-of-inference-optimization-the-real-llm-infra-trend-shaping-2026/

Caso SubQ (mayo 2026)

- Introducing SubQ (subq.ai): https://subq.ai/introducing-subq

- Miami startup claims 1,000x AI efficiency gain; researchers demand independent proof (VentureBeat): https://venturebeat.com/technology/miami-startup-subquadratic-claims-1-000x-ai-efficiency-gain-with-subq-model-researchers-demand-independent-proof

- Subquadratic launches with $29M (SiliconANGLE): https://siliconangle.com/2026/05/05/subquadratic-launches-29m-bring-12m-token-context-windows-ai/

- Hacker News thread (escepticismo técnico): https://news.ycombinator.com/item?id=48023079

Industria

- Rise of Hybrid LLMs (AI21): https://www.ai21.com/blog/rise-of-hybrid-llms/

- Model Wars 2026: Qwen 3.5 & Gemma 4 (dasroot): https://dasroot.net/posts/2026/05/model-wars-2026-qwen-35-gemma-4-local-inference/

Internal Research — Intelia. Si quieres profundizar en un sub-tema concreto (Mamba con detalle matemático, KV compression hands-on, comparativa MoE 2026), pidamos otra nota dedicada.